Os médicos não conseguiram ajudá-las. Elas apostaram na IA

Quando Margie Smith ficou doente em 2022, ela procurou ajuda de uma série de especialistas. Consultou um alergista por causa de uma tosse persistente; três pneumologistas pela tosse e falta de ar; um otorrinolaringologista devido a um refluxo severo; e um cardiologista após quase desmaiar durante exercícios. Ela teve a impressão de que a maioria estava limitada às suas especialidades e não conseguia montar o quadro completo.

Para cães e gatos: com que frequência você deve alimentar seu animal de estimação?

Pré-eclâmpsia: cientistas controlam evolução da doença em grávidas usando filtragem de sangue

Eventualmente, Smith, de 70 anos, de Swannanoa, na Carolina do Norte, recorreu ao chatbot de inteligência artificial Claude. Por meio de conversas longas, além de um grupo no Facebook, concluiu que tinha Covid longa, que estava causando disautonomia — uma condição comum em síndromes pós-virais, na qual o corpo tem dificuldade para regular funções como pulso, pressão arterial, digestão e temperatura.

Hoje, Smith vai às consultas com sugestões da IA em mãos e escolhe profissionais, em parte, com base na abertura deles ao papel da tecnologia em suas decisões. Segundo ela, a combinação de recomendações médicas e do Claude tornou seus sintomas mais controláveis.

— O sistema de saúde realmente falhou comigo. É bom depender de IA para aconselhamento médico? Acho que não. Mas é a opção disponível — diz.

Cada vez mais pessoas recorrem a chatbots em busca de orientação de saúde: um terço dos adultos os utiliza para esse fim, segundo pesquisa divulgada em março.

Uma reportagem anterior do The New York Times revelou que um grupo expressivo são mulheres com doenças crônicas complexas, muitas vezes pouco compreendidas. Elas podem levar anos para obter um diagnóstico, quanto mais alívio. Isso ocorre, em parte, porque os sintomas abrangem múltiplas especialidades. Mas também porque muitas dessas doenças — como Covid longa e enfermidades autoimunes — afetam desproporcionalmente mulheres, e médicos tendem a minimizar ou atrasar o tratamento de seus sintomas.

Centenas de pessoas responderam a um pedido para contar como estavam usando IA para a saúde. Desde então, o jornal realizou dezenas de entrevistas sobre os padrões identificados.

As mulheres entrevistadas disseram saber que chatbots frequentemente fornecem informações incorretas, e algumas relataram erros graves. A maioria afirmou que preferiria depender de médicos, mas sente que não pode.

— Há muitos problemas no uso de chatbots para aconselhamento médico — diz James Landay, codiretor do Instituto de IA Centrada no Humano da Universidade Stanford. — Mas também precisamos reconhecer que há um motivo para as pessoas fazerem isso.

Padrão antigo

Pacientes há muito tempo fazem autodiagnósticos por meio de fóruns, redes sociais, Google e WebMD. É fácil encontrar casos de pessoas ignoradas por médicos que pesquisaram por conta própria e estavam certas — assim como outras que seguiram tratamentos não aprovados e cometeram grandes erros.

Assim, de certa forma, usar IA para compensar falhas no sistema de saúde é uma nova versão de uma velha história, explica John J. Whyte, CEO da American Medical Association. Mas a natureza da tecnologia a torna mais poderosa — e mais arriscada.

Os chatbots frequentemente convidam as pessoas a descrever seus históricos médicos em detalhes, inclusive enviando resultados de exames. E podem oferecer respostas que parecem personalizadas, completas e confiáveis — mesmo quando não são.

Algumas startups estão testando produtos de IA especializados para ajudar no diagnóstico de doenças. Mas chatbots de uso geral “não foram avaliados de forma abrangente” para diagnósticos personalizados e podem cometer erros significativos, afirma Danielle Bitterman, líder clínica de ciência de dados e IA no Mass General Brigham.

Modelos de IA podem usar tanto fontes de alta quanto de baixa qualidade, ou até “alucinar”. Usuários nem sempre recebem referências, a menos que peçam, e é preciso conhecimento científico para avaliar se essas fontes são confiáveis.

Chatbots às vezes conseguem diagnosticar casos difíceis. É o caso de Patty Costello, pesquisadora em Idaho.

Há mais de uma década, Costello começou a se sentir mal ao acordar. Tinha crises de náusea, diarreia, azia e fadiga por dias ou semanas, com pausas, mas sem melhora duradoura. Consultou vários médicos, fez diversos exames — alguns indicaram inflamação —, mas sem diagnóstico. As crises se tornaram mais frequentes.

“Isso está arruinando minha vida”, contou ao ChatGPT no ano passado, descrevendo seus sintomas e mencionando a inflamação.

Entre nove possíveis diagnósticos, o chatbot citou a síndrome de ativação de mastócitos (MCAS), na qual células do sistema imunológico reagem de forma equivocada, desencadeando reações alérgicas sem gatilho claro. Costello disse que tudo o que leu sobre a doença parecia corresponder aos seus sintomas.

Ela procurou um alergista com essa hipótese e recebeu o diagnóstico de MCAS. Com medicação, estima estar cerca de 80% melhor.

Costello não é a única a encontrar um diagnóstico com ajuda da IA, mas sua experiência não é a regra.

Um estudo publicado em fevereiro mostrou que, quando pessoas sem formação médica receberam cenários detalhados e instruções para usar chatbots para identificar diagnósticos e próximos passos, o acerto ocorreu menos da metade das vezes.

Alguns pacientes procuraram médicos assustados com doenças graves que não condiziam com seus sintomas, relata Whyte. Outros receberam falsas garantias de chatbots e deixaram de investigar problemas sérios. Embora nenhuma das pessoas entrevistadas para esta reportagem tenha relatado danos, médicos dizem já ter atendido pacientes que consumiram substâncias perigosas ou recusaram tratamentos para condições potencialmente fatais.

Um porta-voz da OpenAI, empresa responsável pelo ChatGPT, citou uma declaração anterior de Karan Singhal, líder da equipe de saúde da companhia. Ele afirmou que o estudo de fevereiro não refletia o uso real dos chatbots. A empresa destacou que seus modelos evoluíram, mas reforçou que ainda “não substituem orientação médica profissional”.

A Anthropic, criadora do Claude, não respondeu ao pedido de entrevista.

Alfabetização científica

Não surpreende que muitas histórias de sucesso envolvam pessoas com conhecimento médico. Caroline Gamwell, 31, é fisioterapeuta do assoalho pélvico em Denver. Ela tem formação em anatomia e fisiologia e atende pacientes com dor crônica.

Sua própria dor começou na adolescência. Sentia espasmos na coluna, no tronco e na pelve, como se “tudo estivesse se torcendo”. Durante relações sexuais, a sensação era semelhante a de uma lixa. Aos 17 anos, disseram que era ansiedade; na faculdade, fibromialgia; na pós-graduação, síndrome da fadiga crônica e sintomas psicossomáticos; depois, novamente fibromialgia. Mas ela não achava que o diagnóstico fazia sentido.

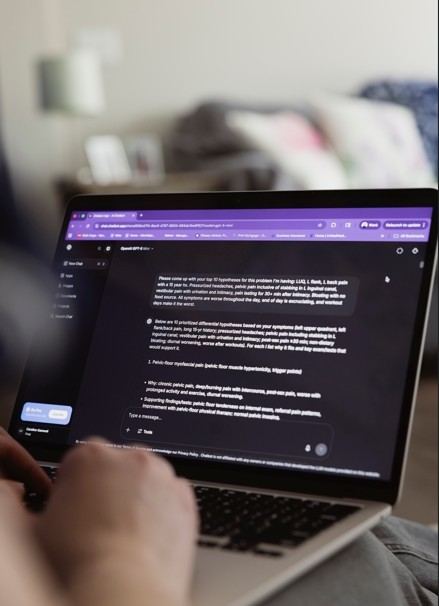

Em outubro de 2025, descreveu seus sintomas ao ChatGPT com termos médicos precisos e pediu 10 possíveis diagnósticos. Sua experiência permitiu descartar várias sugestões. Em mais de 12 mil palavras de interação, contestou hipóteses improváveis e explorou as mais plausíveis.

Uma das sugestões foi síndrome da congestão pélvica, uma doença vascular. Gamwell buscou um procedimento que confirmou o diagnóstico. Foi operada em janeiro e hoje está sem sintomas.

— Sinto muita vontade de mandar uma mensagem para meu médico e dizer: “Eu te avisei” — afirma. — “Você queria que eu vivesse o resto da vida com essa dor.”

Ela reconhece que muitos usuários não teriam condições de usar o ChatGPT dessa forma. Quantas pessoas, questiona, perceberiam que várias sugestões não faziam sentido?

Além do diagnóstico, muitas pessoas usam chatbots para tentar controlar doenças crônicas. Deborah Holcomb, de 62 anos, ex-engenheira elétrica em San Diego, tem encefalomielite miálgica/síndrome da fadiga crônica e consegue se movimentar por cerca de 30 minutos por dia. Ela considera os chatbots valiosos para identificar padrões de sintomas e explorar tratamentos, embora não faça mudanças importantes sem consultar um médico.

No entanto, observa que, embora os chatbots sejam treinados com evidências científicas, também incorporam ideias pseudocientíficas e equívocos populares.

Holcomb ficou alarmada quando o ChatGPT sugeriu “exercício regular”, já que a intolerância ao esforço é característica da doença, e até atividades leves podem piorar os sintomas. Mas, acrescenta, alguns médicos também fazem essa recomendação.

Samantha Allen Wright, 36, professora de inglês em Iowa, usa o ChatGPT para buscar informações sobre enxaquecas e uma forma de disautonomia chamada POTS. Segundo Wright, o ChatGPT foi mais útil do que qualquer profissional ao sugerir mudanças alimentares para POTS que consideravam suas preferências, náuseas frequentes e enxaquecas.Por outro lado, “ele frequentemente interpreta exames de forma errada, superanalisando pequenas discrepâncias”.

— Em um caso, destacou um nível de triglicerídeos que seu médico garantiu estar normal. Em outro, após sintomas gastrointestinais com um novo medicamento, afirmou incorretamente que eram comuns, citando um estudo inexistente.

Assim como Gamwell, Wright tem conhecimento relevante. Não é médica, mas pesquisa doenças e deficiência e sabe avaliar evidências de forma crítica.

— Sem isso, como eu saberia se ele está me dizendo a coisa certa? — questiona.