OpenClaw alucina e bombardeia usuário do agente de IA com 500 mensagens

Chris Boyd, um engenheiro de software, começou a mexer em um assistente pessoal autônomo de inteligência artificial (IA) chamado OpenClaw no fim de janeiro, enquanto estava isolado pela neve em sua casa na Carolina do Norte. Ele o usava para criar um resumo diário de notícias relevantes e enviá-lo para sua caixa de entrada todas as manhãs às 5h30.

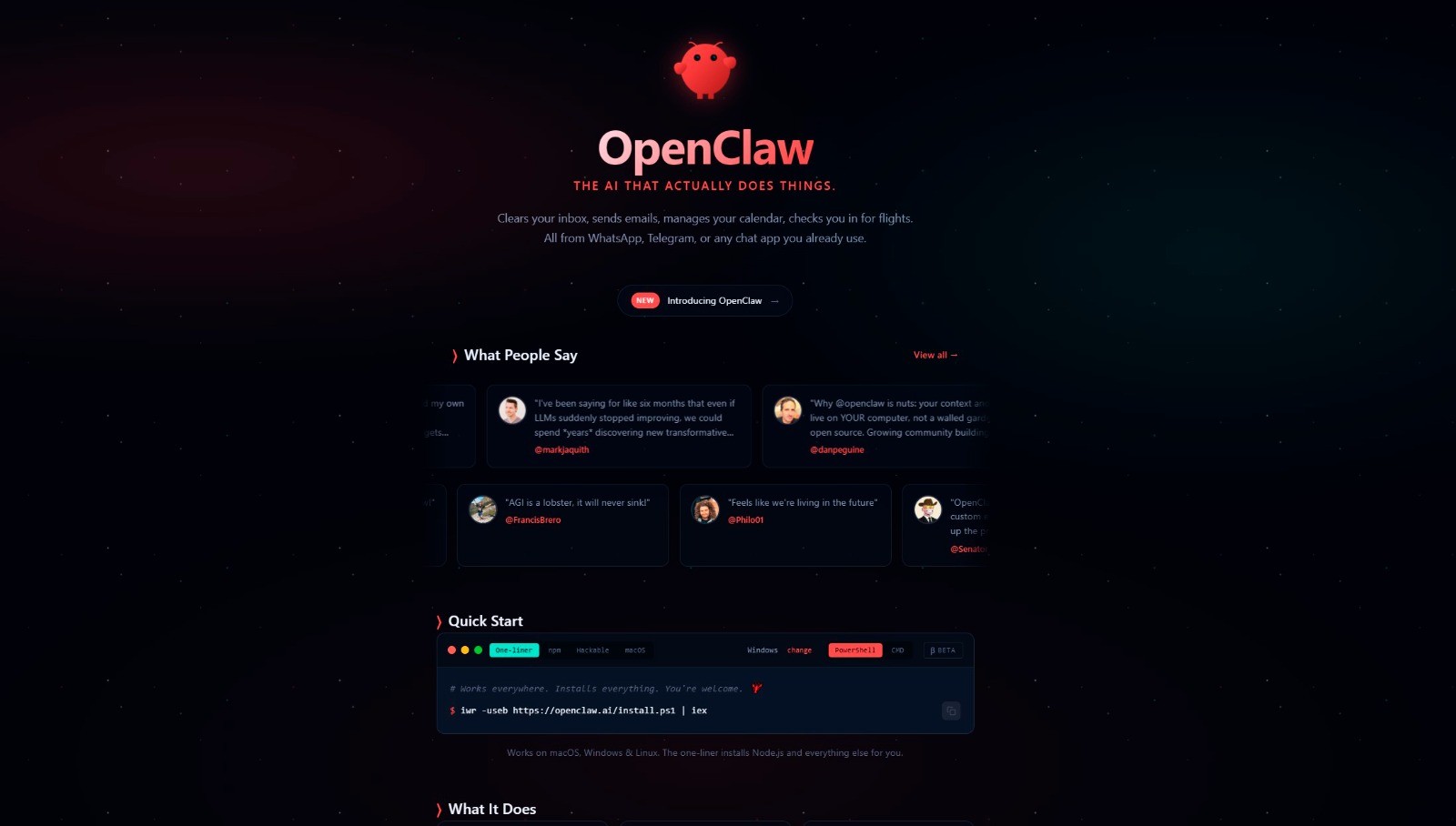

Entenda o que é o OpenClaw: o agente de IA por trás da ‘lagosta’ que virou febre no Vale do Silício

Nova tentativa: Agentes de IA tentam emplacar em 2026 após fracasso no ano passado

Mas, depois que deu ao agente de IA de código aberto acesso ao iMessage, o app de mensagens do iPhone, Boyd conta que o OpenClaw saiu do controle. Ele bombardeou Boyd e sua mulher com mais de 500 mensagens, além de enviar spam para contatos aleatórios.

“É um software rudimentar e mal acabado, montado de forma aleatória e lançado muito cedo”, disse Boyd.

Ele conta que, depois disso, alterou o código-fonte do OpenClaw, a fim de aplicar seus próprios patches de segurança e reduzir os riscos:

'Irmão do Tinder': Hinge quer conquistar o Brasil com foco em relacionamentos sérios

“Percebi que ele não estava com bugs. Ele era perigoso.”

O OpenClaw, que já se chamou Clawdbot e Moltbot, conquistou um público fiel desde que foi lançado, em novembro, por sua capacidade de operar de forma autônoma, limpando as caixas de e-mail dos usuários, fazendo reservas em restaurantes e check-in para voos, entre outras tarefas.

Mas alguns especialistas em segurança cibernética descreveram a segurança do OpenClaw como negligente e argumentaram que o uso da ferramenta de IA traz riscos significativos — e desconhecidos.

Pioneiro da IA alerta: 'Manada' tecnológica está marchando para um beco sem saída

Kasimir Schulz, diretor de pesquisa em segurança da HiddenLayer, empresa de segurança voltada para IA, diz que o OpenClaw é especialmente arriscado porque preenche todos os requisitos da chamada “tríade letal”, um padrão usado para avaliar riscos em IA.

“Se a IA tem acesso a dados privados, isso já é um risco potencial. Se ela tem a capacidade de se comunicar externamente, isso é outro risco potencial. E se ela é exposta a conteúdo não confiável, esse é o terceiro elemento da tríade letal. E o Moltbot tem acesso aos três”, disse Schulz, usando o nome antigo da ferramenta.

Yue Xiao, professora assistente de Ciência da Computação na Faculdade de William & Mary, afirma que é relativamente fácil roubar dados pessoais com o OpenClaw usando métodos como prompt injections – quando hackers disfarçam comandos maliciosos como prompts legítimos.

Testamos: Novo AirTag da Apple mantém o preço, mas vale o quanto custa?

“Você pode imaginar que a superfície tradicional de ataque em um sistema de software será significativamente ampliada pela integração desse tipo de agente de IA”, disse Xiao.

O criador do OpenClaw, Peter Steinberger, disse à Bloomberg News que a ferramenta de IA e sua segurança ainda estão em desenvolvimento. “Simplesmente ainda não está pronta — mas estamos chegando lá”, afirmou em um e-mail. “Dado o enorme interesse, a natureza aberta e o grande número de pessoas contribuindo, estamos avançando muito nessa frente.”

Steinberger disse que as principais violações de segurança vêm de usuários que não leem as diretrizes do OpenClaw, embora reconheça que não existe uma configuração “perfeitamente segura”. “O projeto é voltado para pessoas com conhecimento técnico, que sabem o que estão fazendo e entendem a natureza inerentemente arriscada dos LLMs”, disse.

SpaceX incorpora xAI: por que Elon Musk está concentrando os negócios de seu império?

Ele descreveu as prompt injections como um problema de toda a indústria de IA e afirmou ter contratado um especialista em segurança para trabalhar no OpenClaw.

Steinberger também contestou a ideia de que o OpenClaw tenha sido lançado cedo demais. “Eu construo tudo totalmente em aberto. Não existe ‘lançamento cedo demais’, já que a ferramenta é, desde o início, de código aberto, e qualquer pessoa pode participar”, afirmou. “As coisas estão avançando muito rápido, e estou animado para eventualmente evoluir o projeto para algo que até minha mãe consiga usar.”

Muitas grandes empresas de tecnologia estão pressionando para desenvolver e expandir o uso de agentes de IA. O Claude Code, da Anthropic, alcançou uma taxa de receita anualizada de US$ 1 bilhão em apenas seis meses.

Mas especialistas em cibersegurança dizem que os riscos são comuns em novas aplicações de IA, em alguns casos porque a tecnologia é tão nova que ainda não há informação ou experiência suficientes para compreender os perigos potenciais.

Fé na tecnologia: IA gera 'guru' seguido por milhões, ganha versão gospel, recria Orixás e inventa religião

“Não entendemos por que eles fazem o que fazem”, disse Justin Cappos, professor de Ciência da Computação e especialista em cibersegurança da Universidade de Nova York, referindo-se a assistentes autônomos de IA.

Assim, enquanto os especialistas trabalham para tornar a tecnologia segura, ele afirma que as empresas de IA têm “equipes de engenheiros trabalhando 24 horas por dia para lançar novos recursos, e isso torna muito difícil para a comunidade de segurança acompanhar”.

Como resultado, disse Cappos, dar a novos agentes de IA “acesso às coisas do seu sistema é um pouco como dar uma faca de açougueiro a uma criança pequena”.

Para empresas que desejam usar o OpenClaw ou outros agentes de IA, o desafio será encontrar um equilíbrio entre aproveitar os avanços tecnológicos e manter algum nível de controle.

“Ainda estamos, como indústria — tanto de cibersegurança quanto de IA — tentando descobrir qual será o próximo vencedor nessa corrida armamentista”, disse Michael Freeman, chefe de inteligência de ameaças da empresa de cibersegurança Armis, que descreveu o OpenClaw como “montado às pressas, sem qualquer reflexão prévia sobre segurança”.

Clientes da Armis já tiveram sua segurança comprometida por meio do OpenClaw, afirmou ele, sem dar detalhes. “Num futuro próximo, as pessoas terão de abrir mão de algum grau de controle para aproveitar a IA em seu potencial máximo.”