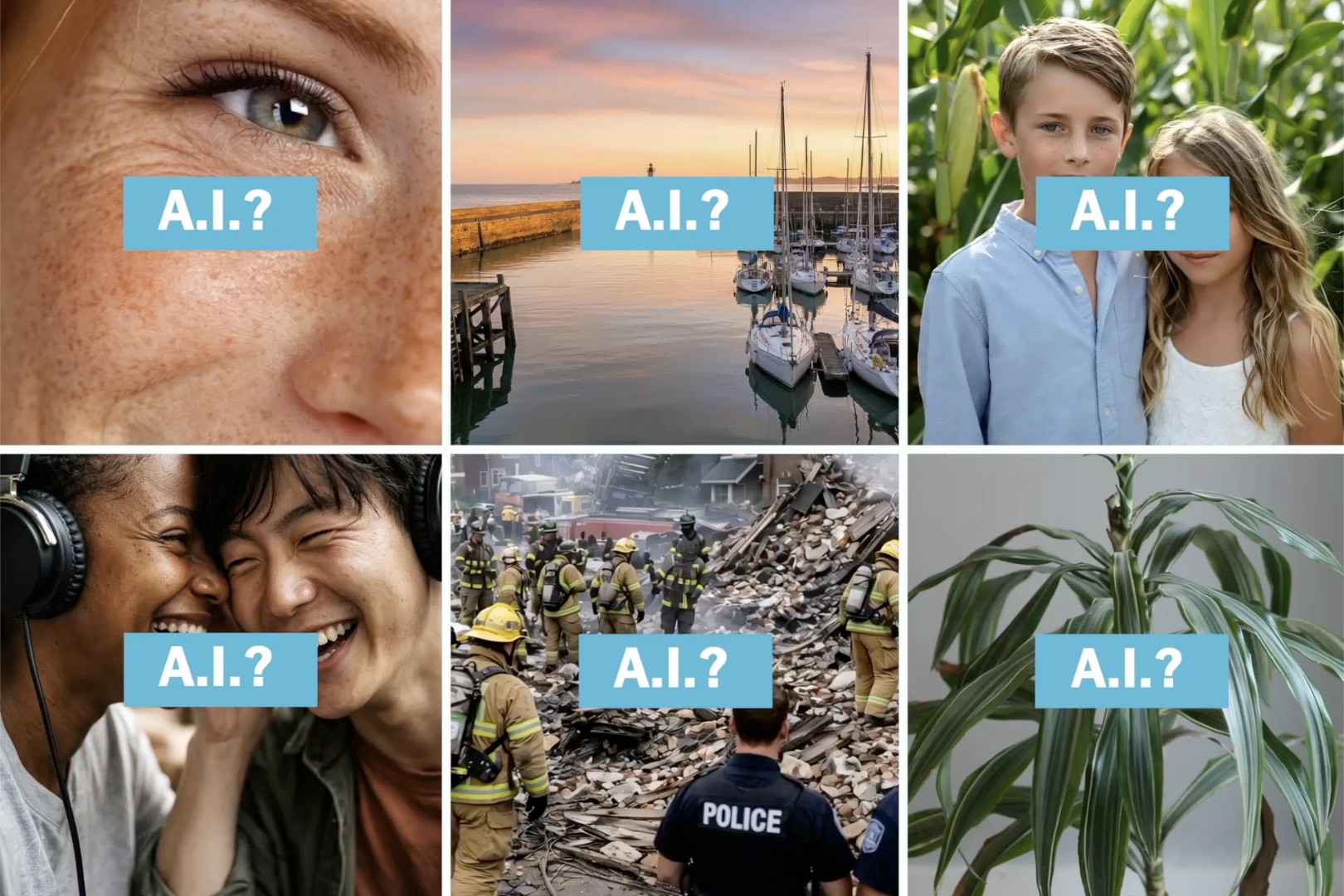

Ferramentas prometem identificar falsificações feitas por IA, mas elas realmente funcionam?

Conteúdo gerado por inteligência artificial tornou-se tão realista que muitas vezes é impossível dizer se um vídeo ou uma imagem que circula nas redes sociais é verdadeiro ou falso.

Entram em cena os detectores de IA.

Mais de uma dúzia de ferramentas online afirmam conseguir diferenciar o que é real do que é gerado por IA ao procurar marcas d’água ocultas, erros de composição e outros indícios digitais.

A realidade é mais mista, segundo uma bateria de testes conduzida pelo The New York Times. Embora muitas ferramentas tenham se saído bem na detecção de alguns conteúdos de IA, elas não foram precisas o suficiente para oferecer total confiança aos usuários.

Os resultados sugerem que esses detectores podem ajudar a confirmar suspeitas sobre mídias geradas por IA, mas é difícil confiar em qualquer um deles para emitir conclusões definitivas. Isso cria novos desafios para usuários da internet e checadores de fatos que tentam lidar com a enxurrada de falsificações por IA que tomou as redes sociais nos últimos meses.

De modo geral, constatamos que qualquer conclusão tirada por essas ferramentas deve ser apoiada por outras formas de verificação, como detalhes em fotografias oficiais ou reportagens jornalísticas.

Ainda assim, muitas pessoas veem essas ferramentas de detecção — que agora analisam não apenas imagens, mas também vídeos e áudios — como árbitros poderosos da verdade em um momento crucial, em que conteúdos gerados por IA se espalham pelas redes sociais e enganam usuários durante acontecimentos de última hora. As ferramentas estão sendo adotadas por bancos e seguradoras que tentam identificar fraudes com IA, por professores em busca de plágio e por investigadores online que tentam verificar imagens e vídeos que circulam nas redes.

— Você nunca vai ter uma ferramenta de detecção capaz de identificar com 100% de certeza se IA foi usada em texto, imagens, vídeo ou qualquer outro formato — diz Mike Perkins, professor da British University Vietnam que estudou detectores de IA e concluiu que detectores de texto eram pouco confiáveis. À medida que os geradores de IA melhoram, afirma, os detectores terão dificuldade para acompanhar, criando uma “corrida armamentista”.

Nossos testes analisaram mais de uma dúzia de detectores de IA e chatbots capazes de identificar vídeos, áudios, músicas e imagens falsas, realizando mais de 1.000 análises ao todo.

Veja o que encontramos.

Muitos conseguiam detectar falsificações básicas

A maioria dos conteúdos falsos de IA que circula hoje na internet não exige muito esforço para ser criada: usuários podem digitar comandos simples e receber uma imagem ou vídeo realista de pessoas reais. Esse tipo de conteúdo inundou a internet logo após Nicolás Maduro, presidente deposto da Venezuela, ser preso em janeiro.

Para testar isso, pedimos ao ChatGPT, o chatbot de IA da OpenAI, que criasse uma fotografia de duas pessoas rindo. Ele produziu uma imagem realista que, ainda assim, continha vários indícios de geração por IA: a iluminação, a composição e os traços eram perfeitos demais, além de uma mão que parecia ondular de forma pouco natural.

Muitos detectores de IA identificaram rapidamente que a imagem era gerada por IA, com algumas exceções. O ChatGPT, por exemplo, não conseguiu detectar a imagem falsa que ele próprio havia criado momentos antes. (O Times processou a OpenAI e sua parceira Microsoft, alegando violação de direitos autorais de conteúdo jornalístico relacionado a sistemas de IA. OpenAI e Microsoft negaram as acusações.)

Detectores de IA geralmente são treinados com enormes coleções de conteúdos gerados por IA, aprendendo a identificar os sinais digitais deixados por essas ferramentas.

O Times compartilhou os resultados dos testes com as empresas de detectores de IA. Muitas responderam que nenhum detector será totalmente preciso o tempo todo. Como sinal da rapidez com que esse setor evolui, várias empresas disseram estar prestes a lançar atualizações importantes em seus modelos, que teriam melhor desempenho.

“Esta será uma batalha contínua para determinar ‘isso é IA ou não?’ no futuro próximo”, escreveu Anatoly Kvitnitsky, CEO da AI or Not, em um e-mail. A empresa realizou testes adicionais com imagens que seu modelo público não conseguiu identificar e constatou que sua versão mais recente conseguiu classificá-las corretamente como geradas por IA.

Eles tiveram dificuldades com imagens mais complexas

Os detectores tiveram mais dificuldade com imagens como uma cena fictícia de um porto à beira-mar com poucos indícios de que foi criada por IA.

Isso pode ocorrer porque alguns detectores são treinados principalmente para identificar rostos, para uso em segurança e prevenção a fraudes.

Poucos detectores conseguem analisar vídeos

Vídeos gerados por IA estão rapidamente se tornando a próxima grande ameaça nas redes sociais. O lançamento do Sora, um aplicativo gerador de vídeos por IA criado pela OpenAI, levou a uma onda de vídeos falsos nas redes — com poucos avisos por parte das plataformas indicando que eram falsos.

Apenas alguns detectores de IA são capazes de analisar vídeo e áudio. Aqueles que conseguiam apresentaram resultados mistos.

Vídeo e áudio surgiram como ameaças importantes para a segurança de empresas: imagine receber uma ligação de um CEO que, na verdade, é uma réplica de IA da voz dessa pessoa, ou participar de uma videoconferência com um personagem de IA que parece real. Empresas de detecção investiram muito dinheiro para identificar esse tipo de fraude, oferecendo ferramentas capazes de determinar se vídeo, áudio ou música foram gerados por IA, inclusive analisando transmissões ao vivo. Algumas análises destacavam quais partes de um vídeo eram falsas e quais eram consideradas reais.

Eles são melhores na detecção de áudio falso

Áudios gerados por IA avançaram rapidamente e se tornaram especialmente realistas.

Ferramentas como as da ElevenLabs criam vozes extremamente convincentes, com respirações, pausas e entonação dinâmica. Essas vozes são usadas em vídeos virais e memes, mas também em golpes telefônicos e imitações.

Sete dos detectores e chatbots que testamos conseguiam verificar áudio falso, e Sensity e Resemble.ai tiveram o melhor desempenho nesse aspecto. Mesmo quando o áudio estava bastante alterado, as ferramentas conseguiram concluir com alta confiança que as vozes ou músicas eram geradas por IA. Elas também identificaram corretamente vozes reais em nossos testes.

Eles tiveram melhor desempenho ao identificar imagens reais

Um risco dos detectores de IA é classificar algo verdadeiro como falso, gerando confusão em notícias em desenvolvimento ou levantando dúvidas sobre imagens autênticas. Quando uma imagem chocante de um corpo carbonizado circulou nas redes sociais no início do conflito entre Israel e Hamas, alguns observadores a descartaram como uma falsificação por IA. Vários especialistas disseram que provavelmente era real, mas, até então, as dúvidas já haviam se espalhado.

No geral, os detectores tiveram melhor desempenho ao identificar imagens reais do que falsas.

Eles também se saíram bem ao analisar vídeos reais — como gravações feitas com iPhone ou reportagens baixadas da internet. Embora áudios gerados por IA tenham enganado alguns detectores, todos classificaram corretamente um vídeo de um repórter lendo um texto gerado por IA como sendo real.

Imagens reais editadas com IA apresentaram desafios específicos

Algumas falsificações por IA combinam conteúdo real com elementos gerados artificialmente para criar imagens ainda mais difíceis de identificar a olho nu. A Casa Branca, por exemplo, publicou uma imagem alterada de uma mulher que foi presa em Minneapolis no mês passado. A maioria dos detectores de IA considerou a imagem alterada como real.

Constatamos que a maioria dos detectores também não conseguiu identificar essas alterações em nossos testes.